한국에서 인공지능(AI)을 활용한 전화 사기가 역대 최대 피해를 기록하며 심각한 사회 문제로 떠오르고 있다. 경찰과 금융당국에 따르면, 최근 사기범들이 다중 기관 사칭 수법을 사용해 피해자를 속이고 조종하는 사례가 급증하고 있다. 이들은 검사, 금융감독원 직원, 은행 직원, 심지어 배달원으로 위장해 다크웹에서 미리 수집한 개인정보를 활용, 피해자의 신뢰를 얻는다. 이후 가짜 링크가 포함된 문자 메시지를 보내 악성 애플리케이션 설치를 유도하거나, 피해자의 휴대폰을 제어해 돈을 송금하도록 유도한다.

심리 조종과 AI 기술 악용

사기범들은 피해자를 심리적으로 조종해 판단력을 흐리게 만드는 수법을 사용한다. 전라북도 익산시의 한 사례에서는 20대 남성이 자신이 범죄에 연루됐다고 믿게 되어 며칠간 호텔에 숨어 지냈다. 그가 5,000만 원을 송금하려던 순간 경찰의 개입으로 피해를 막을 수 있었다.

특히, 사기범들은 딥페이크(deepfake) 또는 **딥보이스(deep voice)**와 같은 AI 기술을 활용해 피해자의 친척이나 지인의 목소리를 흉내 내 돈을 요구한다. 한 대학교수는 외동딸의 목소리로 위장한 전화를 받고 급히 5,000만 원을 송금할 뻔했으나, 이는 AI로 생성된 가짜 목소리였다.

피해 규모와 연령대 분석

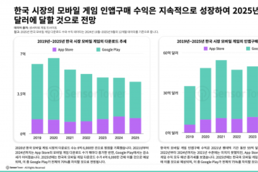

한국 경찰에 따르면, 기관 사칭 사기의 피해자 중 52%가 30세 미만이며, 저금리 대출 사기의 피해자는 40~60세 사이의 사업 활동이 많은 연령대가 80%를 차지한다. 평균 피해액은 2022년 2,326만 원에서 2025년 7,554만 원으로 급증하며, 사기 피해 규모가 갈수록 커지고 있다.

낮은 검거율과 대응 방안

전문가들은 이 같은 범죄 증가의 원인 중 하나로 낮은 검거율을 꼽는다. 사기범들이 국제적인 네트워크를 활용하고, 다크웹에서 개인정보를 쉽게 입수하며, AI 기술로 흔적을 감추는 점이 수사를 어렵게 만든다. 이에 따라 전문가들은 국제 사법 공조 강화와 금융기관이 의심스러운 거래를 감지했을 때 경찰과 즉시 협력할 수 있는 권한 확대를 촉구했다. 또한, 금융기관이 의심 거래를 사전에 경고하고 조율할 수 있는 시스템 구축이 필요하다고 강조했다.

당국의 경고와 예방책

경찰은 국민들에게 의심스러운 전화나 문자 메시지에 주의하고, 특히 낯선 링크를 클릭하거나 개인정보를 공유하지 말 것을 당부했다. AI 기반 사기의 경우, 목소리나 영상의 미세한 왜곡, 부자연스러운 말투를 통해 딥페이크 여부를 확인할 수 있으며, 긴급 송금을 요구하는 경우 반드시 신뢰할 수 있는 경로로 신원을 확인해야 한다고 조언했다.

한국 사회가 AI 기술의 급속한 발전과 함께 새로운 형태의 범죄에 직면한 가운데, 정부와 금융기관, 그리고 시민들의 협력이 피해를 줄이는 데 핵심이 될 것으로 보인다.